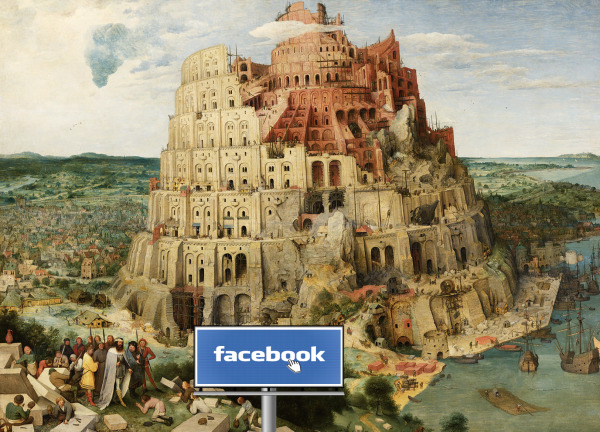

Les révélations et scandales autour de Facebook continuent d’être feuilletonnés et chaque jour on prend connaissance de nouveaux éléments qui démontrent toute la toxicité cynique de cette entreprise. Chaque jour on se demande aussi comment elle peut encore tenir devant de tels scandales. Et chaque jour on constate qu’elle tient encore.

Chroniquant également ces révélations, Alexandre Piquard signait un papier dans Le Monde rappelant que, comme permettent de le prouver la fuite de documents internes à l’entreprise :

« dans des dizaines de langues et des pays à haut risque, les systèmes de modération du réseau social face aux discours de haine et aux manipulations ne sont pas suffisants.«

En gros, Facebook se préoccupe essentiellement de ce qu’il se passe aux Etats-Unis et en Europe en termes de modération automatique et humaine des contenus violents ou haineux. Et laisse se multiplier les faux-comptes et les appels à la haine contre des minorités (ethniques, religieuses, sexuelles …) dans des pays (nombreux …) pour lesquels ils ne dispose pas de modérateurs capables de maîtriser les langues ou dialectes parlés et où, en termes de modération « automatique », Facebook explique manquer d’outils linguistiques de catégorisation automatique (« classifiers« ).

Extrait de l’article du Monde :

« Mais les documents internes montrent que ceux-ci sont également limités par les langues. Selon la note sur l’Afghanistan, seuls 2 % des contenus haineux modérés dans le pays sont ainsi repérés automatiquement, contre plus de 90 % en moyenne dans le monde entier. Le problème est que ces systèmes informatiques ont besoin de « classifiers », des catégories qui leur permettent de reconnaître un type de contenu problématique, par exemple sexuel ou haineux, mais qui nécessitent un entraînement à partir d’un grand volume de données dans la langue correspondante. « Cela prend du temps », constate un employé dans un document.

Dans un tableau dévolu aux pays les plus risqués, daté de juin 2020, il est ainsi précisé que des « classifiers » de désinformation manquent en Birmanie, au Pakistan, en Ethiopie, en Syrie ou au Yémen. Idem pour les contenus trompeurs ou dangereux sur le Covid-19, en pendjabi ou en oromo, ainsi que pour les discours de haine en oromo et en amharique. « Notre manque de classifiers en hindi et en bengali signifie que beaucoup de ces contenus ne sont pas signalés ou modérés », regrette un employé dans la note sur l’Inde, citant des propos « antimusulmans »…

La suite est à lire sur: www.affordance.info

Auteur: olivierertzscheid Olivier Ertzscheid